靠AI生成视频拿下2500万用户的团队转做「视频修正Buzzy」,融资2000万美元

时间:2026-04-30 11:09:27

小编:china

阅读:

声明:本文来自于微信公众号 白鲸出海,作者:白鲸出海,授权站长之家转载发布。

过去⼀年,AI 视频可能是整个 AI 应用领域里最拥挤的赛道之⼀。

从 Sora 到可灵、从 Veo 到 Seedance ,基模公司之间的竞争已经白热化。应用层也不甘示弱,画布分镜、脚本生成、⼀键成片 ……几乎每⼀种“从0到1生成视频”的路径都挤满了选手。在所有人都在抢“生成”份额的节点,一家已经拥有2500万用户、ARR 做到1500万美元的 AI 视频公司,推出了新产品 ΓBuzzy」,却选择做⼀件看起来不那么性感的事——视频修改。

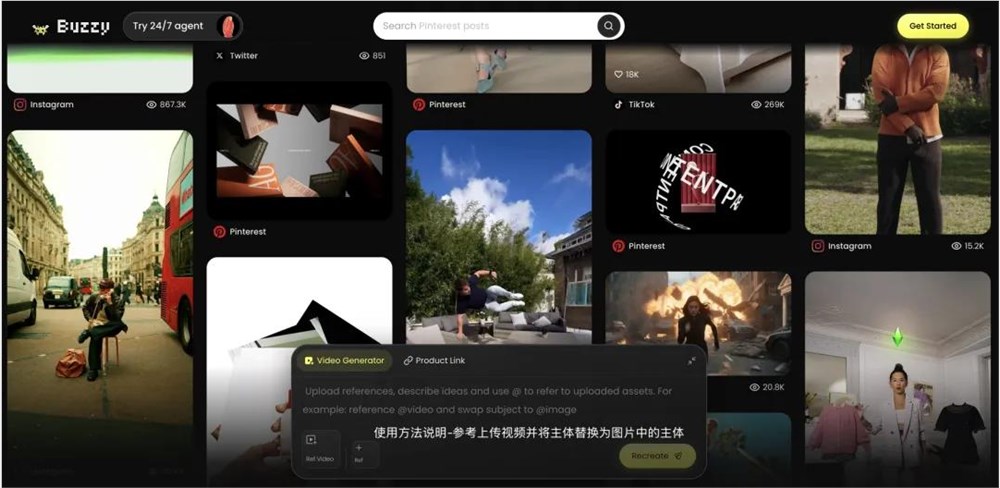

在上周二的产品发布会上,创始人张诗莹把 ΓBuzzy」定位为“视频版 Photoshop”——不生成视频,而是修改视频,在移动端可以通过 Openclaw 调用其能力,也可以在 PC 端访问官网修改视频。大致的使用路径是——用户上传已有的视频素材,通过自然语言告诉 ΓBuzzy」想改什么, 换个人物、调个光线、去掉路人、亦或是把⾃家商品替换进广告。

Buzzy 官网

这个方向能否成立、产品做到了什么程度、为什么⼀家已经在视频生成方向小有成绩的团队会在此时转向“修改”?带着这些问题,多家机构和张诗莹进行了一次对话。以下内容基于此次交流整理,为保留对话语境,采用问答形式呈现。

一、为什么不继续做生成?

Q:根据你们的数据,团队此前的产品 ΓCreati」 已经做到了2500万用户和1500万美元 ARR,视频生成方向显然是被验证过的,为什么新产品选择了视频修改?

张诗莹:现在市面上的 AI 视频产品大概分两类。一类是复杂画布类型的,另⼀类是基于脚本生成视频的,都面向专业用户,一是需要用户有很明确的计划和意图,二是需要用户非常有耐心地去拼分镜、调细节,门槛其实很⾼。

而我们观察到的用户画像恰恰相反——他们的需求是模糊的,大概知道想要个什么样的效果,但说不清楚具体要求,更习惯的方式是“看到初稿之后提迭代要求”。

而市面上的产品,都在解决生成问题,但忽略了生成之后的迭代需求。

Q:刚提及观察到的用户画像是 Creati 之前的用户?但市面上也已经有一些 AI 视频编辑工具了,你们看到的机会在哪里?

张诗莹:对,我们在做 ΓCreati」的过程中接触了大量 SMB(中小商家)、跨境电商从业者以及内容创作者,我们发现了一个很明显的现象,大多数用户的需求是“我已经有了一个视频,但有些地方不满意,想改⼀改”。

可能是口播视频里背景太杂需要优化,可能是拍好的旅游视频里有不想要的路人,也可能是广告素材里的商品需要替换成新的 SKU。这些需求目前的解决方案要么是重新拍⼀遍,要么是打开 AE、PR 这样的专业软件花几个小时去处理。对我们的用户来说,两种方案都太重了。

如果最初的需求就是模糊的,官网有一个 Inspire Me 板块,有很多优秀的内容可以提供给用户灵感,配合修改功能生成适合自己的内容。

二 、Chat to Edit:产品长什么样?

Q:能具体介绍⼀下 ΓBuzzy」的产品形态吗?用户怎么使用它?

张诗莹:核心交互就是 Chat to Edit。用户上传⼀段视频,然后用自然语言描述想要的修改。比如“把视频里的人物换成我和我老婆”、“加上电影感的光线”、“去掉画面里的路人”,系统理解之后直接生成修改后的版本。

我们也提供一些快捷的功能建议,比如“cinematic lighting”这种常用修改方向,用户可以⼀键选择。目前生成⼀次修改后视频⼤概需要5到10分钟。

Q:这个交互确实降低了门槛,但“自然语言改视频”听起来也意味着很多不确定性。比如用户说“光线太差,帮我加 studio 级别的光线”,产品加完之后的效果可能和用户设想的不一样,二次修改又会浪费算力,我们如何做到准确理解并实现用户的修改意图?

张诗莹:我们会很快先给到用户一个关键帧的修改画面,让用户通过关键帧的修改效果来判断是否符合自己的修改意图,继续往下走。同时我们也会提供给用户在画面上直接圈中局部精细修改的交互功能来帮助用户做精细改动。

Q:B 端用户的场景是怎样的?

张诗莹:B 端有很多种使用方法。

比如一个跨境电商卖家的某一条红人广告视频效果很好,他可以把那条视频上传到 ΓBuzzy」,把里面的商品替换成自己家其他的产品,系统还会根据新商品的卖点自动调整广告文案。或者,他们在手机上拍一张商品图,用我们的模板直接⽣成⼴告素材。

另外,我们还提供一个功能,Buzzy 可以根据用户提供的产品链接,分析商品信息和竞品广告,为用户推荐合适的广告创意,并重新生成新的广告素材,帮他们解决“不知道该拍什么”的问题。

Q:不论是刚才的用户案例演示,还是网站设计,都传递出“二创”是⼀个主要场景,担不担心创意趋同会带来内容同质化,不论是个人创作者还是小商家,都最终又会面临”核心指标“不好看的困境?

张诗莹:ΓBuzzy」主要的卖点是视频修改,大部分用户的需求还是集中于修改自己的视频,避免使用复杂的软件或重新拍摄。对于需要寻找创意的小部分跨境电商卖家, ΓBuzzy」会根据产品的不同生成全新的故事线,并非简单的模板套用。所有创意都会需要一些灵感来源,并非空穴来风,二创更重要的点在于创,可以通过「Buzzy」生成全新的创意。

三、大厂也在做视频编辑,壁垒在哪?

Q:一个很现实的问题是视频编辑并不是一个全新的品类,从 Adobe 到剪映,大厂的资源和用户基础都远超创业公司。选择这个方向,怎么跟大厂竞争?

张诗莹:我们内部也反复讨论过这个问题。⾸先要明确的是,Buzzy 并非传统意义上的视频编辑,更多的是视频内容修改,也就是传统所说的 P 视频,这和剪映这类时间线编辑是完全不一样的产品。其次视频⽣成赛道对基模的依赖非常大,这意味着最终可能是基模公司或者大厂的战场。但视频修改不⼀样,它更依赖应用层的交互体验和对用户需求的理解,这是创业公司可以做出差异化的地方。

具体来说,我们认为创企可以在2个层⾯搭建壁垒。第⼀是交互体验,视频修改是多轮交互的,用户可能改完光线又想改视角,这个过程中怎么让用户更高效地表达需求、怎么在多轮修改之间保持⼀致性,应用层可以做大量优化。

第二是品味沉淀——灵感 Agent 根据用户平时分享的视频和想法理解他们的品味,然后在首页做个性化推荐,持续学习用户的审美偏好。时间越长,产品对用户的理解越深,这是⼀个越用越好用的过程。

Q:技术上, ΓBuzzy」是否强依赖某个特定的基模?如果基模公司自己做了类似的编辑功能呢?

张诗莹:我们没有绑定任何一个基模,策略是“水涨船高”——基模能力提升,我们的产品体验也跟着提升。目前我们用到了 Sora、Veo3、Seedance2.0等多个模型,同时自研了⼀些小模型来保证特定场景下的确定性,比如商品替换时的⼀致性问题,我们在这方面有⼀定的积累。

Q:如果有⼀天不能用Seedance2.0了,对你们影响会很⼤吗?

张诗莹:我们并不绑定特定基模,所以不能用 seedance2.0对我们影响不大,当然 Seedance2.0的确定性高很多,能有效降低“抽卡率”,对产品体验也会有比较大的提升。

Q:这是你们公司推的第三款产品了,能聊聊每次推新产品的逻辑吗?

张诗莹:2021年公司成立的时候,第⼀款产品 ZMO 是用GAN 技术生成模特图,主要在疫情期间服务电商客户,包括 SHEIN 和⼀些海外奢侈品品牌。那个阶段我们主要做 ToB,但后来发现 ToB 并不是我们擅长的方向。

2023年底到2024年初,视频模型开始兴起,我们看到了⼀个更大的机会,就果断关掉了 ZMO,推出了 ΓCreati」,专注视频生成。这个产品我们从⼀开始就想清楚了要做移动端, 因为⼀些小商家和创作者有很强的 on-the-go 需求,随手拍摄,我们可以说踩中了这部分需求,另外通过模板降低写 prompt 的门槛。2024年4月发布后,一年内用户增长到1000万,现在已经超过2500万。

做 ΓBuzzy」的逻辑在前面也提到了,本质上是我们在服务这2500万用户的过程中,发现了“生成之后的修改”这个没被很好解决的需求。所以 ΓBuzzy」和 ΓCreati」不是替代关系,而是互补 ——一个负责生成,一个负责修改。

Q:融资情况可以透露⼀下吗?

张诗莹:我们在今年年初完成了新一轮融资,领投方是红点(Redpoint),金额大概2000万美金,主要用于 ΓBuzzy」的发布和视频编辑方向的研发。

写在最后

ΓBuzzy」带给用户的是一种新的视频编辑体验,当然,产品还处于刚发布的阶段——15秒的修改时长限制、5-10分钟的生成等待这些都是团队自己也在正视的问题,比如团队将在五一后上线时间轴,准确锚定要修改的时间段,降低生成等待时间和修改的准确性。

但张诗莹在对话中反复强调的⼀个判断:产品都在帮用户生成,但很少产品帮助用户“改到满意”,确实是视频生成中不断碰到的一个痛点,也需要新的产品形态来解决。但与此同时,基模能力的快速演进、用户对“视频修改”作为独立付费场景的接受度,这些变量都还需要创业团队不断探索与验证,我们拭目以待 Buzzy 的新征程。

-

靠AI生成视频拿下2500万用户的团队转做「视频修正Buzzy」,融资2000万美元声明:本文来自于微信公众号 白鲸出海,作者:白鲸出海,授权站长之家转载发布。过去⼀年,AI 视频可能是整个 AI 应用领域里最拥挤的赛道时间:2026-04-30

靠AI生成视频拿下2500万用户的团队转做「视频修正Buzzy」,融资2000万美元声明:本文来自于微信公众号 白鲸出海,作者:白鲸出海,授权站长之家转载发布。过去⼀年,AI 视频可能是整个 AI 应用领域里最拥挤的赛道时间:2026-04-30 - 智能眼镜苦战正酣,谷歌把票投给了Rokid声明:本文来自于微信公众号 光锥智能,作者:刘俊宏 魏琳华,授权站长之家转载发布。AR+AI,在2026年迈入了更深的融合。近日,Google Clo时间:2026-04-30

-

顺丰同城发布2025年度ESG陈述,AI+无人手艺赋能,激活行业低碳生态4月28日,杭州顺丰同城实业股份有限公司(顺丰同城)发布2025年度《环境、社会及管治报告》(ESG报告),连续第五年向社会披露可持续发展实践时间:2026-04-30

顺丰同城发布2025年度ESG陈述,AI+无人手艺赋能,激活行业低碳生态4月28日,杭州顺丰同城实业股份有限公司(顺丰同城)发布2025年度《环境、社会及管治报告》(ESG报告),连续第五年向社会披露可持续发展实践时间:2026-04-30 -

世纪华通《2025可延续开展陈述》,以恒久主义加重信赖砝码4月29日,世纪华通集团(002602 SZ)发布第五份年度《可持续发展报告》,围绕治理先行、连接未来、人尽其才、精准向善、和谐发展五大维度,时间:2026-04-30

世纪华通《2025可延续开展陈述》,以恒久主义加重信赖砝码4月29日,世纪华通集团(002602 SZ)发布第五份年度《可持续发展报告》,围绕治理先行、连接未来、人尽其才、精准向善、和谐发展五大维度,时间:2026-04-30 - 莫氏鸡煲老板还剩40万债权 老莫,还完就扎实了广东顺德那个火遍全网的“莫氏鸡煲”,老板老莫最近在一段公开采访里,晒出了自己的还债“账本”。2015年,他投资了180多万承包鱼塘,想着时间:2026-04-30

热门阅读

-

哥哥抚慰腮腺炎弟弟 得知传染秒变脸

阅读:116

-

华为FreeClip 2推送鸿蒙OS 6晋级,支撑星闪音频 抗搅扰才能提拔

华为FreeClip 2推送鸿蒙OS 6晋级,支撑星闪音频 抗搅扰才能提拔

阅读:80

-

95岁广东白叟扮演一字马火了 自己谈长命诀要,1天喝2瓶可乐

阅读:47

-

刘文祥塌房紫薯精改吃大理寺米线 网友,筹办整理升咖

阅读:45

-

这才是东北春季最霸气的开场,百万只大雁春季迁移

阅读:45